Google’ın bir müddettir geliştirdiği Magenta Projesi, gerçek vakitli yapay zeka dayanaklı açık kaynak müzik üretimi ile ileriye hakikat bir adım daha atıyor. Google DeepMind dayanaklı yeni Magenta RealTime modeli, kullanıcıların canlı olarak müzik üretip şekillendirebilmesine imkan tanıyor. Bu model daha evvel sırf Lyria RealTime üzerinden erişilebilen teknolojileri açık tartılarla ve geliştirici odaklı bir yaklaşımla erişime açıyor.

Google’ın bir müddettir geliştirdiği Magenta Projesi, gerçek vakitli yapay zeka dayanaklı açık kaynak müzik üretimi ile ileriye hakikat bir adım daha atıyor. Google DeepMind dayanaklı yeni Magenta RealTime modeli, kullanıcıların canlı olarak müzik üretip şekillendirebilmesine imkan tanıyor. Bu model daha evvel sırf Lyria RealTime üzerinden erişilebilen teknolojileri açık tartılarla ve geliştirici odaklı bir yaklaşımla erişime açıyor. Magenta RT, yaklaşık 190 bin saatlik stok enstrümantal müzik üzerinde eğitilmiş, 800 milyon parametreli otoregresif bir transformer modeli. Model şu anda fiyatsız Colab TPU’larında çalışıyor lakin ilerleyen devirde lokal aygıtlarda kullanılabilecek biçimde optimize edilmesi hedefleniyor.

Canlı ve etkileşimli müzik üretimi

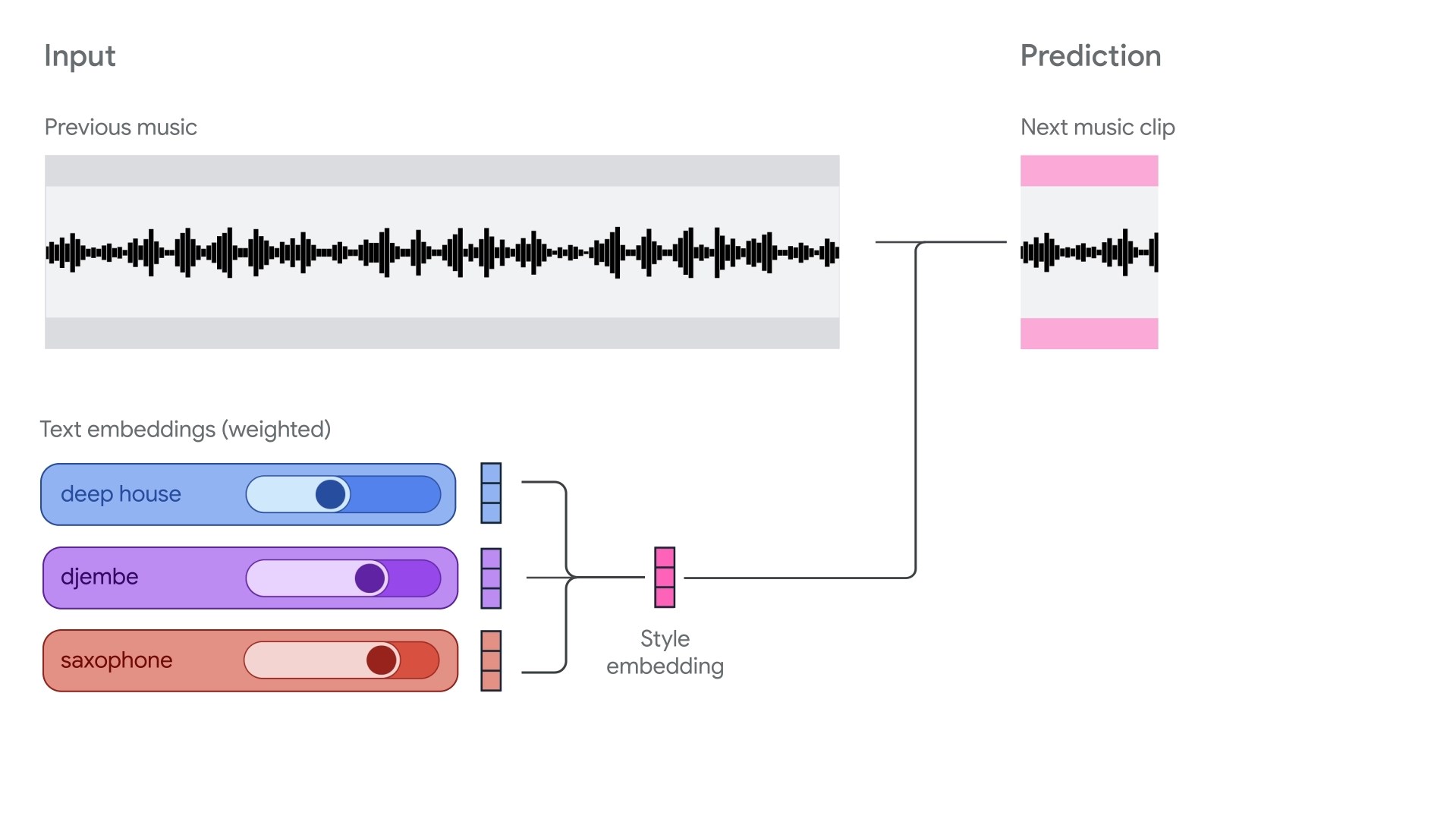

Magenta RT, müzik üretimini gerçek vakitli hâle getirerek hem performans sırasında hem de yaratım sürecinde kullanıcıya tam denetim sağlıyor. Model, önceki ses çıktıları ve bir tarz vektörü üzerinden yeni ses blokları üretiyor. Bu yapı sayesinde kullanıcılar, farklı usulleri, enstrümanları ve müzikal nitelikleri canlı olarak karıştırıp yine şekillendirebiliyor. Blok bazlı otoregresyon tekniğiyle çalışan model, sesleri 2 saniyelik kısımlar hâlinde ve gecikmesiz olarak üretiyor. Bu, bir performans esnasında yapay zekâ takviyeli doğaçlamaların mümkün olabileceği manasına geliyor.

Magenta RT, Google’ın evvelki ses modellerinden SoundStream’in yerini alan SpectroStream tabanlı 48kHz stereo ses üretimini destekliyor. Ayrıyeten müzikle metni birlikte anlayabilen yeni bir gömülü model olan MusicCoCa ile güçlendirilmiş. Bu altyapı sayesinde, hem metin hem de ses girdileriyle ayrıntılı müzikal yönlendirme yapılabiliyor.

Magenta RT, Google’ın evvelki ses modellerinden SoundStream’in yerini alan SpectroStream tabanlı 48kHz stereo ses üretimini destekliyor. Ayrıyeten müzikle metni birlikte anlayabilen yeni bir gömülü model olan MusicCoCa ile güçlendirilmiş. Bu altyapı sayesinde, hem metin hem de ses girdileriyle ayrıntılı müzikal yönlendirme yapılabiliyor. Magenta RT’nin en çarpıcı taraflarından biri de canlı müzik üretimini interaktif keşif alanına dönüştürmesi. Kullanıcılar, iki farklı şekil ortasında geçişler yapabiliyor, sıra dışı enstrüman kombinasyonlarını deneyebiliyor ya da kendi örneklerini kullanarak özgün ses dokuları oluşturabiliyor.

Açık kaynak yaklaşımı

Google’ın açıklamasına nazaran Magenta RT, sırf geliştiricilere değil, araştırmacılara, sanatkarlara ve yaratıcı kod müelliflerine da hitap ediyor. Kodlar GitHub’da, model yükleri ise Google Cloud Storage ve Hugging Face üzerinden, müsaadeli açık lisanslarla erişime açılmış durumda.

Öte yandan Magenta RealTime hâlâ araştırma kademesinde olan bir model olduğundan birtakım teknik ve içerik sınırlamaları bulunuyor. Model, yüklü olarak Batı enstrümantal müziği üzerinde eğitildiği için vokal performansları ve daha geniş kültürel müzik gelenekleri konusunda hudutlu bir kapsama sahip. Bu nedenle daha çeşitli usulleri destekleyen gerçek vakitli üretimler için Lyria RealTime API öneriliyor. Ayrıyeten model şarkı kelamlarına dayalı bir eğitim almadığı için, söz üreten vokal performanslar yerine yalnızca hırıltı, mırıldanma üzere sesler üretebiliyor.

Gecikme süresi açısından bakıldığında, model iki saniyelik ses blokları hâlinde çalıştığı için kullanıcıdan gelen tarz komutlarının tesirinin duyulması birkaç saniye sürebiliyor. Son olarak, modelin ses sürece penceresi sırf on saniyelik bir geçmişi kapsayabiliyor. Bu, kısa melodiler, ritimler ve akor geçişleri üretmek için kâfi olsa da, uzun soluklu müzik yapıları oluşturmak için kâfi değil.